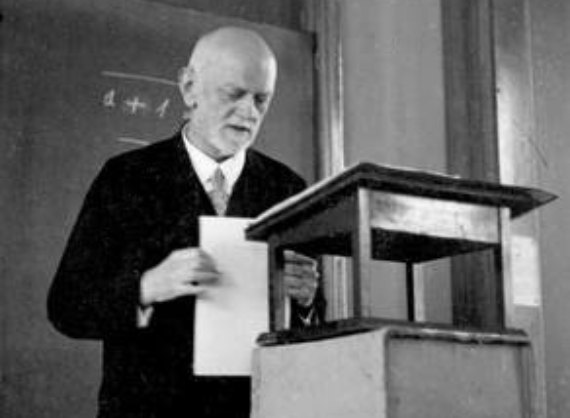

En el año 1900, en el Congreso Internacional de Matemáticos celebrado en París, el matemático alemán David Hilbert pronunció la conferencia “Los problemas de la matemática” en la que presentó algunas cuestiones por resolver en la disciplina y que, tras su publicación en las actas de aquel congreso, quedarían conformadas como un corpus denominado los “Problemas de Hilbert”.

Fuente: The Oberwolfach Photo Collection, Autor: Kay Piene

De la lista original conformada por veintitrés cuestiones abiertas en aquel momento, solo siete siguen siendo una incógnita, mientras que los demás han sido resueltos total o parcialmente.

Una de estas soluciones, concretamente a la cuestión segunda sobre la axiomatización de la aritmética, es decir, la posibilidad de formalizar la aritmética de tal manera que ninguno de dichos axiomas fueran contradictorios entre sí, fue ofrecida en el año 1929 por un joven matemático de tan solo veintitrés años: Kurt Gödel.

Para cuando Gödel debía elegir un tema para su tesis doctoral, cayó en sus manos un ejemplar de Fundamentos de lógica teórica publicado en 1928 por Hilbert y Ackermann, y que seguía la línea de los intentos iniciados medio siglo antes por Gottlob Frege sobre axiomatización de toda la matemática que, por aquel entonces, todavía se creía posible. Así pues, en los Fundamentos quedaba planteado el problema de la completitud con vistas a ofrecer una solución que Hilbert esperaba satisfactoria: “¿son suficientes los axiomas de un sistema formal para derivar cada una de las proposiciones verdaderas en todos los modelos del sistema?”.

Fuente: Álbum familiar de los Gödel

La respuesta de Gödel, un año después (aunque serían oficialmente publicados en 1931), ponía fin a más de medio siglo de discusiones y trabajos de los matemáticos más preeminentes de la época sobre el tema: los teoremas de incompletitud de Gödel.

Los enunciados de los teoremas dicen, de manera sencilla, lo siguiente:

- Primer teorema de incompletitud: cualquier teoría aritmética recursiva que sea consistente, es incompleta.

- El segundo teorema, un caso del primero, expresa que en toda teoría aritmética consistente, la sentencia que demuestra dicha consistencia, no forma parte de la teoría.

En resumidas cuentas, un sistema formal definido por un algoritmo, como por ejemplo un programa informático, no puede ser, al mismo tiempo, coherente y completo.

Es decir, si un programa es completamente válido para un determinado fin, la coherencia se la ha de dar una sentencia externa a ese sistema. Por el contrario, si es perfectamente coherente, debemos admitir que no valdrá para toda la finalidad para la que el algoritmo que define el sistema fue diseñado, por lo que llegará un momento en el que la intervención de una sentencia externa volverá a ser necesaria. Hoy por hoy, esa “sentencia” sigue siendo el hombre que es quien comprueba si la finalidad del programa se cumple en todo o si se cumple bien.

En el año 2017, los ingenieros de Facebook Artificial Intelligence Research, tuvieron que apagar dos “bots”, Bob y Alice, con los que experimentaban sobre las posibilidades en negociación de la inteligencia artificial. Tras un tiempo, Bob y Alice comenzaron a interactuar mediante un lenguaje compuesto por palabras aparentemente inconexas e incoherentes. Tras la inicial atribución a un error en el sistema, un análisis más profundo determinó que Bob y Alice habían creado su propio lenguaje, mucho más directo que el inglés. Es decir, ignoraron el lenguaje con el que habían sido creados y, por tanto, ante la dificultad para la creación de redes neuronales que esto supone, decidieron desenchufar a Bob y Alice.

Pero, ¿es esto todo lo que ocurrió? ¿Son éstas todas las implicaciones? Pongámoslo en perspectiva:

- Bob y Alice son dos personalidades teóricas que se suelen utilizar en Teoría de Juegos para ilustrar diversos escenarios de cooperación y/o competencia. El escenario de competencia extrema por antonomasia son los juegos de suma cero. Es decir, aquellos en los que uno de los jugadores gana todo a costa de la pérdida total del otro.

- También en 2017, Tay, la IA de Microsoft destinada a entablar conversaciones con sus seguidores en redes sociales, acabó publicando frases como “Hitler tenía razón, odio a los judíos”. Otro al que hubo que desenchufar.

¿Qué habría ocurrido si Tay, puesta como sistema de control de un silo nuclear, hubiese “decidido” que, al igual que el inglés es poco directo, podría solucionar su “problema” con los judíos de la misma manera que Bob y Alice hicieron con el suyo?, es decir, desarrollar una “solución” más directa pero aparente, humanamente, incoherente.

Es más, ¿qué ocurriría si la sentencia fuera del sistema, la que da coherencia o completitud al mismo, dejara de ser el hombre y Alice o Bob crearan otra IA para llegar a dónde ellos no llegan completa y coherentemente a la vez de una manera más “directa”?

Imaginemos un caso extremo. Pensemos en un sistema diseñado “para proteger a la humanidad” con capacidad de autorreplicarse para, por ejemplo, adaptarse a nuevos escenarios que no se previeron o no se pudieron prever en el desarrollo original, pero para el que era consistente (y, por tanto, no completo en su propósito). En busca de la completitud en su finalidad, se generaría al menos una incongruencia en el sistema “proteger a la humanidad”. Lo incongruente con “proteger” es, al menos, “no proteger”. Si no hubiera ningún ataque externo, ¿no protegerla sería atacarla para poder protegerla? Y si fuera inconsistente, ¿en qué fallaría en su protección? El problema para el sistema sería entonces el propio sistema, que para buscar su coherencia dejaría de ser completo y pasaríamos al punto anterior. Es decir, siempre se necesita que un “no hablante algorítmico” cierre ese ciclo.

Gödel murió en el año 1978 de inanición. Obsesionado con la posibilidad de ser envenenado, solo consentía comer algo si era su mujer Adele quien lo preparaba. Cuando Adele tuvo que ser hospitalizada y no pudo cocinar para su marido, Kurt, coherente, rehusó comer cualquier cosa y murió pesando 30 kilos. Dejó de ser completo. Incluso de aspirar a serlo.

Algo así deberíamos preguntarnos con el desarrollo de la IA:

- ¿Debe una IA poder desarrollarse a sí misma en busca de la adaptación a nuevos escenarios? ¿O, como Gödel, su total coherencia, debería suponer su propia muerte por inanición para dejar de buscar la completitud?

- ¿Debería limitarse por ley la IA a escenarios concretos prohibiendo su adaptación a propósitos generales?

- Dada la limitación intrínseca de la IA, que no puede ser coherente y completa a la vez, ¿puede ser el escenario de un nuevo humanismo? A fin de cuentas es el hombre, que no solo habla el lenguaje limitado de los algoritmos, quien da completitud y coherencia a sus propias creaciones.

- Si el lenguaje humano en su estructura es un algoritmo, pero no su sentido, ¿ese nuevo humanismo debe estar centrado en el sentido? Es decir, ¿se debe abrir una nueva época en la que, siendo el sentido el propósito, en la que la ética, la filosofía, deber ser un valor estratégico a la altura de cualquier otra consideración empresarial o comercial?

Quizá sea un buen momento para parar y pensar. A fin de cuentas, el desarrollo por el desarrollo tiene aspectos que no pueden ser coherentes y completos a la vez si no es por el hombre. Que sea para él.

Comentarios sobre esta publicación