Dado que la viralidad en internet suele ser cíclica, recientemente ha vuelto a ganar popularidad una app que ya hizo su debut en 2017. FaceApp aplica transformaciones a la imagen de cualquier rostro, pero ha sido especialmente popular la opción de envejecer los rasgos. Sin embargo, el divertimento ha venido acompañado de polémica: dado que los sistemas biométricos están reemplazando a las contraseñas de acceso, ¿es prudente ceder nuestra imagen y nuestros datos personales? Lo cierto es que hoy el rostro está dejando de ser tan intransferible como solía; y en solo unos años, podría ser más hackeable que la contraseña de toda la vida.

Nuestro semblante es la llave más reconocible para relacionarnos socialmente. Podemos dudar ante una voz escuchada por teléfono, pero nunca ante el rostro de una persona familiar. En los años 60, un puñado de investigadores pioneros comenzó a entrenar a las computadoras para reconocer rostros humanos, aunque no fue hasta los 90 cuando esta tecnología comenzó a despuntar. Los algoritmos de reconocimiento facial han mejorado de tal modo que desde 1993 su tasa de error se ha ido reduciendo a la mitad cada dos años. Cuando se trata de reconocer rostros no familiares en experimentos de laboratorio, los sistemas actuales llegan a superar las capacidades humanas.

Hoy estos sistemas se cuentan entre las aplicaciones más extendidas de la Inteligencia Artificial (IA). A diario, nuestros ordenadores portátiles, smartphones y tabletas nos saludan por nuestro nombre al reconocer nuestras facciones. Pero al mismo tiempo, los usos de esta tecnología han hecho saltar las alarmas de invasión de la privacidad. En China, el líder mundial en sistemas de reconocimiento facial, la introducción de esta tecnología asociada a las cámaras de vigilancia para identificar incluso a los peatones ha sido valorada desde Occidente como un paso más hacia la distopía del Gran Hermano, el ojo del estado que todo lo vigila, como retrató George Orwell en 1984.

Sin embargo, en los últimos años el uso del rostro en los algoritmos de IA ha ido mucho más allá de la mera identificación para entrar en el terreno de la recreación. Esto está comenzando a derribar la premisa básica del carácter intransferible de nuestros rasgos faciales; la idea de que, allí donde esté nuestra cara, por fuerza estamos nosotros.

La recreación de expresiones faciales

En 2016 y 2017 se reveló el poder de ciertos algoritmos para modificar vídeos del rostro de una persona, de modo que se le pudieran trasplantar las expresiones faciales de otra o se adaptara el movimiento de sus labios para hacerla decir lo que nunca dijo ante una cámara. Fue famoso el ejemplo en el que un discurso en audio del expresidente de EEUU Barack Obama se adaptó a un vídeo en el que originalmente pronunciaba otro discurso diferente. Al mismo tiempo surgía la polémica de los llamados deepfakes, transformaciones virtuales que algunos programadores amateurs empleaban para trasplantar rostros de actrices de Hollywood a las intérpretes de vídeos pornográficos.

Pero mientras que estos deepfakes necesitaban emplear un gran banco de imágenes del modelo original para aprender y recrear sus expresiones faciales, ahora ya basta con un único retrato. El pasado mayo, investigadores del Instituto Skolkovo de Ciencia y Tecnología y del Centro de IA de Samsung, ambos en Moscú, publicaban un nuevo sistema que consigue dar movimiento a un rostro a partir de unas pocas capturas o incluso de una sola. Para mostrar el poder de su algoritmo, los investigadores han publicado un vídeo en el que crean bustos parlantes a partir de una única imagen de Marilyn Monroe, Salvador Dalí o Albert Einstein, e incluso dan vida a la Gioconda de Leonardo da Vinci.

Según explica en un comentario sobre el vídeo el primer firmante del estudio, Egor Zakharov, el objetivo de estos sistemas es progresar en la creación de avatares fotorrealistas para facilitar la telepresencia y la comunicación en realidad aumentada y virtual. Para Zakharov, los “diversos efectos positivos” de estas tecnologías incluyen “la reducción de los viajes a larga y a corta distancia” y “democratizar la educación y mejorar la calidad de vida de las personas con discapacidades”, así como “distribuir los empleos de forma más justa y uniforme alrededor del mundo” y “conectar mejor a los parientes y amigos separados por la distancia”.

Vídeo en el que se crean bustos parlantes a partir de imágenes de Marilyn Monroe, Einstein o La Gioconda.

Parecen objetivos sumamente idealistas, pero como es natural Zakharov reconoce también el potencial de su tecnología para crear deepfakes con fines no tan nobles. El investigador apunta que toda nueva herramienta capaz de democratizar la creación de efectos especiales ha acarreado consecuencias indeseables, pero que el balance neto es positivo gracias al desarrollo de recursos que ayuden a atajar estos usos maliciosos. “Nuestra creencia se apoya en el desarrollo constante de herramientas para la detección de vídeos falsos y suplantaciones de caras, junto con el movimiento de las principales compañías tecnológicas hacia la privacidad y la seguridad de los datos”, afirma Zakharov.

Recrear un rostro con voz

Igualmente asombroso, pero quizá más inquietante, es el hecho de que ya ni siquiera se necesite una sola imagen de una persona para recrear su rostro; basta con la voz. En 2014, la investigadora Rita Singh, de la Universidad Carnegie Mellon (EEUU), recibió una petición del Servicio de Guardacostas de EEUU para identificar a un bromista que hacía falsas llamadas de auxilio. Singh ha creado un sistema, basado en algoritmos de redes antagónicas generativas (GAN), que permite obtener una aproximación al físico de una persona solo por su voz: “El audio puede darnos un esbozo facial del hablante, así como su estatura, peso, raza, edad y nivel de intoxicación”, contó Singh al Foro Económico Mundial. “Los resultados muestran que nuestro modelo es capaz de generar caras que encajan con varias características biométricas del hablante, lo que resulta en niveles de coincidencia muy superiores a los del puro azar”, escribían Singh y sus colaboradores en su estudio.

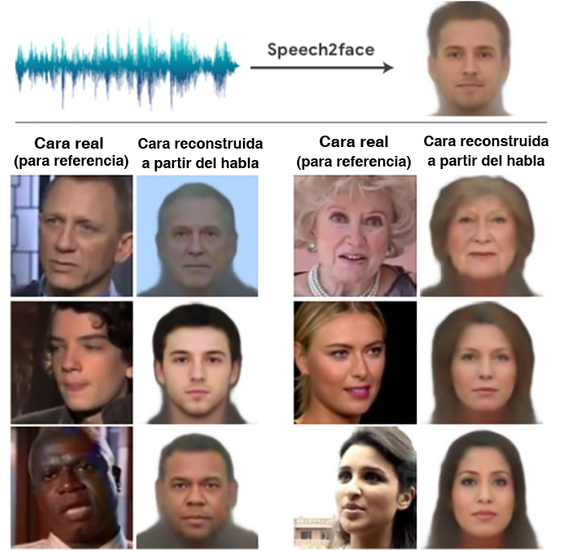

Recientemente, otro equipo del Instituto Tecnológico de Massachusetts ha presentado la red neuronal Speech2Face, que una vez entrenada con millones de vídeos de YouTube y otras fuentes es capaz de construir un rostro a partir de una voz. “Hemos demostrado que nuestro método puede predecir caras probables con atributos faciales congruentes con los de las imágenes reales”, escriben los investigadores en su estudio. Los resultados no son perfectos; los propios autores aclaran que su sistema produce rostros promedio, y no imágenes de personas específicas. Pero teniendo en cuenta que la única fuente es un breve corte de audio, deberemos acostumbrarnos a la idea de que ya ni siquiera nuestra propia cara está a salvo con nosotros.

Comentarios sobre esta publicación