El software, las millones de líneas de código que ejecutan sin cesar nuestros móviles, ordenadores y servidores, ha adquirido un peso fundamental en nuestra sociedad. Si bien hasta hace poco los desarrolladores se veían a sí mismos mayoritariamente como expertos en el ámbito de la tecnología, pero ajenos a otras consideraciones, están ganando fuerza las voces que abogan por mirar al software desde un punto de vista social.

Software ético

El ejemplo más flagrante es sin duda la aplicación indiscriminada del aprendizaje automático (machine learning). Este mismo verano ha sido noticia cómo el gobierno británico usó estas herramientas para extrapolar la nota final de un alumno a partir de multitud de variables. El resultado: notas más bajas dependiendo del barrio donde vivas y del tipo de colegio al que asistas. Para muchos alumnos, esto decide si, y a qué universidad, pueden entrar. En definitiva, su futuro a largo plazo.

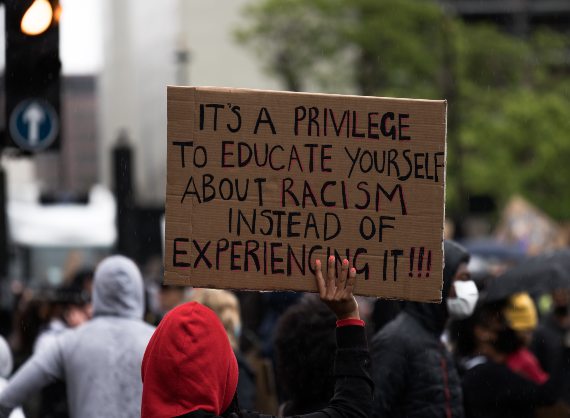

Estos algoritmos también sufren de sesgos o bias en inglés, de raza y género. Por ejemplo, un candidato a un puesto puede ser clasificado como “menos cualificado” simplemente por no ser caucásico, o recibir peor atención médica. En la red podemos encontrar multitud de ejemplos de cómo un software no reconoce caras de personas de color, o cómo una persona que lleva una escoba y un taladro es clasificado como “limpiadora” o “carpintero”.

La explicación de estos hechos es sencilla: estos sistemas aprenden automáticamente. Sí, pero lo hacen a partir de enormes cantidades de datos que introducen los programadores. Si esos datos están sesgados, por ejemplo los alumnos de este colegio suelen recibir notas más altas, las mujeres con una escoba suelen ser limpiadoras, etc. el algoritmo no hará sino reproducir esos prejuicios. Es por eso que cada vez más los buenos desarrolladores intentan asegurarse de que se parte de datos completos y que no se “sobrerrepresenta” a una parte de la población.

También hay aquí un problema de sobreconfianza en la tecnología. Estos sistemas automáticos funcionan como recomendaciones; perfectos para decidir qué canción querrías escuchar o qué ropa te puede sentar bien. Pero cuando un algoritmo es el responsable de decidir quién debe recibir ayudas sociales o si una persona debe ir a la cárcel, estamos eliminando un sistema personalizado y, en mayor o menor medida, transparente por uno opaco e inhumano.

El desarrollo de aplicaciones para el rastreo de la COVID-19 nos ofrece un ejemplo de cómo las tornas están cambiando. En la mayor parte de países de la Unión Europea (véase España, Alemania, entre otros muchos) el código fuente de la aplicación, es decir, las instrucciones de cómo funciona, están disponibles de forma pública. Esto significa que cualquier persona puede ver, aprender y ayudar al desarrollo de las mismas: el software como parte de la sociedad.

Aceptar que el software puede ayudar a la sociedad significa aceptar que puede modificar lo que hacemos. Esto es bien conocido por las grandes empresas tecnológicas, que intentan acaparar nuestra atención y nuestros clics. El reciente documental The Social Dilemma nos abre una puerta a este mundo; el que quiera una mirada menos sensacionalista puede optar por El código 2.0 de Lawrence Lessig para entender cómo el software modifica qué vemos y qué podemos hacer en la sociedad actual. Desde hace unos meses se oyen más voces que se plantean hasta qué punto un buen sueldo y un entorno de trabajo casi idílico deben hacer olvidar el fin último de la tecnología que alguien desarrolla. Hace unos años trabajar en Facebook era el sueño de buena parte de los programadores. Ahora la gente hace más preguntas.

Software sostenible

El gran problema de nuestra generación, el cambio climático, tampoco es ajeno al software. Después de todo, computar y enviar información consume electricidad; por eso Google elige, en parte, el lugar de sus servidores por la factura de la luz. Algunos desarrolladores intentan recortar código no sólo para hacerlo más rápido, sino para reducir la energía necesaria para su transmisión y procesado. La contribución al calentamiento global de esos correos con un simple emoticono se miden en toneladas de CO2 emitidas a la atmósfera.

Según el software se hace más omnipresente en nuestras vidas, aquellos involucrados en su desarrollo toman más conciencia de la sociedad que los rodea. Muchas veces la línea que separa el teclado de los programadores de sus consecuencias es muy corta, demasiado para desentenderse de las mismas. Ética, sostenibilidad, y en definitiva responsabilidad, han sido palabras demasiado alejadas de nuestra profesión. El cambio ya ha comenzado.

Comentarios sobre esta publicación